Verbesserung von Lappensystemen mit nomischen Einbettungen

Mar 03, 2025 pm 06:08 PMMultimodal Abruf-general-generierte Generationssysteme revolutionieren KI, indem verschiedene Datentypen integriert werden-Texttypen, Bilder, Audio und Video-für nuanciertere und kontextbezogene Antworten. Dies übertrifft den traditionellen Lappen, der sich ausschlie?lich auf Text konzentriert. Ein wesentlicher Fortschritt sind Nomic Vision-Einbettungen, die einen einheitlichen Raum für visuelle und textliche Daten erstellen und eine nahtlose Kreuzmodalinteraktion erm?glichen. Fortgeschrittene Modelle erzeugen hochwertige Einbettungen, verbessert das Abrufen des Informationen und die überbrückung der Lücke zwischen verschiedenen Inhaltsformen, letztendlich bereichern die Benutzererfahrungen.

Lernziele

- erfassen die Grundlagen des multimodalen Lappen und ihre Vorteile gegenüber dem traditionellen Lappen.

- Verstehen Sie die Rolle von Nomic Vision -Einbettungen in die Vereinheitlichung von Text- und Bildbettungsr?umen.

- Vergleiche nomische Vision -Einbettung mit Clip -Modellen und Analyse der Leistungsbenchmarks.

- Implementieren Sie ein multimodales Lappensystem in Python mit nomischen Seh- und Texteinbettungen.

- Lernen Sie, Text- und visuelle Daten aus PDFs für multimodales Abrufen zu extrahieren und zu verarbeiten.

*Dieser Artikel ist Teil des Blogathons *** Data Science.

Inhaltsverzeichnis

- Was ist multimodaler Lappen?

- Nomic Vision Emettdings

- Performance -Benchmarks von Nomic Sehbettdings

-

- praktische Python-Implementierung von multimodalem Lappen mit nomischen Seheinbettdings

- Schritt 1: Installieren der erforderlichen Bibliotheken

- Schritt 2: Setzen Sie den OpenAI -API -Schlüssel und importieren Bibliotheken

- Schritt 3: Extrahieren von Bildern aus PDF

- Schritt 4: Text aus PDF

- extrahieren Schritt 5: Sparen extrahierter Text und Bilder

- Schritt 6: STRINK -Textdaten

- Schritt 7: Laden von Nomic -Einbettungsmodellen

- Schritt 8: Erzeugen von Emetten

- erzeugen Schritt 9: Speichern von Texteinbettungen in QDrant

- Schritt 10: Bildungsbettdings in QDrant

- speichern Schritt 11: Erstellen eines multimodalen Retrievers

- Schritt 12: Erstellen eines multimodalen Lappen mit Langchain

- Abfragen des Modells

- Schlussfolgerung

- h?ufig gestellte Fragen

Was ist multimodaler Lappen?

multimodales Lappen stellt einen signifikanten KI -Fortschritt dar, der auf traditionellen Lappen aufbaut, indem verschiedene Datentypen einbezogen werden. Im Gegensatz zu herk?mmlichen Systemen, die in erster Linie Text verarbeiten, werden multimodale Lappenprozesse und integriert mehrere Datenformulare gleichzeitig. Dies führt zu umfassenderen Verst?ndnis- und Kontextbekanntheitsantworten in verschiedenen Modalit?ten.

multimodale Lappenkomponenten der Schlüssel:

- Datenaufnahme: Daten aus verschiedenen Quellen werden mit speziellen Prozessoren aufgenommen, um die Validierung, Reinigung und Normalisierung zu gew?hrleisten.

- Vektordarstellung: Modalit?ten werden unter Verwendung neuronaler Netzwerke (z. B. Clip für Bilder, Bert für Text) verarbeitet, um einheitliche Vektor -Einbettungen zu erstellen, die semantische Beziehungen aufrechterhalten.

- Vektor -Datenbankspeicher: Einbettungen werden in optimierten Vektor -Datenbanken (z. B. QDrant) unter Verwendung von Indexierungstechniken (HNSW, FAISS) für ein effizientes Abrufen gespeichert. .

- Abfrageverarbeitung: Eingehende Abfragen werden analysiert, in denselben Vektorraum wie die gespeicherten Daten umgewandelt und zur Identifizierung relevanter Modalit?ten und zur Generierung von Einbettungen für die Suche verwendet.

Nomic Vision Emettdings

Nomic Vision -Einbettungen sind eine wichtige Innovation, die einen einheitlichen Einbettungsraum für visuelle und textuelle Daten schaffen. Nomic Embett Vision V1 und V1.5, entwickelt von Nomic AI, teilen den gleichen latenten Raum wie ihre Texte (Nomic Einbettetext V1 und V1.5). Dies macht sie ideal für multimodale Aufgaben wie das Abrufen von Text-zu-Image-Abrufen. Mit einer relativ kleinen Parameterzahl (92 m) ist das Nomic-Einbettungsvision für gro? angelegte Anwendungen effizient.

adressierende Clipmodellbeschr?nkungen:

W?hrend CLIP in Null-Shot-Funktionen auszeichnet, unterdurchschnittlich die Textcodierer in Aufgaben über die Bildabnahme hinaus (wie in MTEB-Benchmarks gezeigt). Nomic Embed Vision befasst sich mit dem Sehverteller mit dem Nomic -Einbettungstext latenten Raum.

Nomic Embett Vision wurde neben dem Nomic-Einbettungstext trainiert, wodurch der Textcodierer gefriert und den Visionscodierer auf Bildtextpaaren trainiert wurde. Dies gew?hrleistet optimale Ergebnisse und Rückw?rtskompatibilit?t mit Nomic -Einbettungstext -Einbettungen.

Performance -Benchmarks von Nomic Sehbettdings

Clip-Modelle zeigen zwar in Null-Shot-Funktionen beeindruckend, zeigen jedoch Schw?chen bei unimodalen Aufgaben wie der semantischen ?hnlichkeit (MTEB-Benchmarks). Nomic Embed Vision überwindet dies, indem er seinen Visionscodierer mit dem Nomic Embed Text Latent Space ausrichtet, was zu einer starken Leistung über Bild-, Text- und multimodale Aufgaben führt (ImageNet Zero-Shot, MTEB, DataComp-Benchmarks).  .

.

praktische Python-Implementierung von multimodalem Lappen mit nomischen Seheinbettdings

Dieses Tutorial erstellt ein multimodales Lag -System -Abrufinformationen aus einem PDF mit Text und Bildern (mit Google Colab mit einer T4 -GPU).

Schritt 1: Bibliotheken installieren Installieren Sie die erforderlichen Python -Bibliotheken: OpenAI, Qdrant, Transformers, Torch, Pymupdf usw. (Code für Kürze ausgelassen, aber im Original vorhanden.)

Schritt 2: Setzen Sie den OpenAI -API -Schlüssel und importieren Bibliotheken

Setzen Sie den OpenAI -API -Schlüssel und den importierten Bibliotheken (Pymupdf, Pil, Langchain, Openai usw.). (Code für Kürze weggelassen.)

Schritt 3: Extrahieren von Bildern aus PDF

extrahieren Sie Bilder aus dem PDF mit PYMUPDF und speichern Sie sie in einem Verzeichnis. (Code für Kürze weggelassen.)

Schritt 4: Text aus PDF

extrahierenText aus jeder PDF -Seite mit PYMUPDF extrahieren. (Code für Kürze weggelassen.)

Schritt 5: Sparen extrahierte Daten

extrahierte Bilder und Text speichern. (Code für Kürze weggelassen.)

Schritt 6: STRINK -Textdaten

Teilen Sie den extrahierten Text mit Langchains RecursiveCharacterTextSplitter in kleinere Stücke auf. (Code für Kürze weggelassen.)

Schritt 7: Laden von Nomic -Einbettungsmodellen

Laden Sie den Text- und Vision -Einbettungsmodellen von Nomic mit den Transformers von Sugging Face. (Code für Kürze weggelassen.)

Schritt 8: Erzeugen von Emetten

erzeugenText- und Bildeinbettung generieren. (Code für Kürze weggelassen.)

Schritt 9: Speichern von Texteinbettungen in QDrant

Texteinbettungen in einer QDrant -Sammlung speichern. (Code für Kürze weggelassen.)

Schritt 10: Bildungsbettdings in QDrant

speichernBildeinbettungen in einer separaten QDrant -Sammlung speichern. (Code für Kürze weggelassen.)

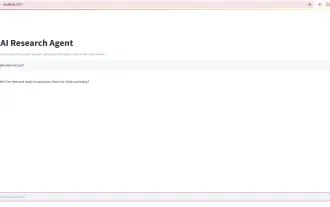

Schritt 11: Erstellen eines multimodalen Retrievers

Erstellen Sie eine Funktion zum Abrufen relevanter Text- und Bild -Einbettungen basierend auf einer Abfrage. (Code für Kürze weggelassen.)

Schritt 12: Erstellen eines multimodalen Lappen mit Langchain

Verwenden Sie Langchain, um abgerufene Daten zu verarbeiten und Antworten mit einem Sprachmodell zu generieren (z. B. GPT-4). (Code für Kürze weggelassen.)

Abfragen des Modells

Die Beispielabfragen demonstrieren die F?higkeit des Systems, Informationen sowohl aus Text als auch aus den Bildern innerhalb des PDF abzurufen. (Beispielabfragen und Ausg?nge für Kürze weggelassen, aber im Original vorhanden.)

Schlussfolgerung

Nomic Vision -Einbettung erh?ht den multimodalen Lappen signifikant und erm?glicht eine nahtlose Interaktion zwischen visuellen und textuellen Daten. Dies befasst sich mit Einschr?nkungen von Modellen wie Clip, der einen einheitlichen Einbettungsraum und einer verbesserten Leistung über verschiedene Aufgaben hinweg bereitgestellt wird. Dies führt zu reicheren, kontextbezogeneren Benutzererlebnissen in Produktionsumgebungen.

Key Takeaways

- Multimodal RAG integriert verschiedene Datentypen für ein umfassenderes Verst?ndnis.

- Nomic Vision Einbettung vereinen visuelle und textuelle Daten für ein verbessertes Informationsabruf.

- Das System verwendet spezielle Verarbeitung, Vektordarstellung und Speicher für ein effizientes Abruf.

- Nomic Embed Vision überwindet Clips Einschr?nkungen bei unimodalen Aufgaben.

h?ufig gestellte Fragen

(FAQs für Kürze weggelassen, aber im Original vorhanden.)

Hinweis: Die Code -Snippets wurden aus der Kürze weggelassen, aber die Kernfunktionalit?t und die Schritte bleiben genau beschrieben. Die ursprüngliche Eingabe enthielt umfangreiche Code; Das Einschlie?en würde diese Reaktion überm??ig lang machen. Siehe die ursprüngliche Eingabe für die vollst?ndige Code -Implementierung.

Das obige ist der detaillierte Inhalt vonVerbesserung von Lappensystemen mit nomischen Einbettungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Hei?e KI -Werkzeuge

Undress AI Tool

Ausziehbilder kostenlos

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem v?llig kostenlosen KI-Gesichtstausch-Tool aus!

Hei?er Artikel

Hei?e Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Hei?e Themen

KI -Investor stillte zum Stillstand? 3 Strategische Wege zum Kauf, Bau oder Partner mit KI -Anbietern

Jul 02, 2025 am 11:13 AM

KI -Investor stillte zum Stillstand? 3 Strategische Wege zum Kauf, Bau oder Partner mit KI -Anbietern

Jul 02, 2025 am 11:13 AM

Das Investieren boomt, aber Kapital allein reicht nicht aus. Mit zunehmender Bewertungen und Verblassen der Unterscheidungskraft müssen Investoren in AI-fokussierten Risikokonstrumentfonds eine wichtige Entscheidung treffen: Kaufen, Bau oder Partner, um einen Vorteil zu erlangen? Hier erfahren Sie, wie Sie jede Option bewerten - und PR

Das unaufhaltsame Wachstum der generativen KI (KI -Ausblick Teil 1)

Jun 21, 2025 am 11:11 AM

Das unaufhaltsame Wachstum der generativen KI (KI -Ausblick Teil 1)

Jun 21, 2025 am 11:11 AM

Offenlegung: Mein Unternehmen, Tirias Research, hat sich für IBM, NVIDIA und andere in diesem Artikel genannte Unternehmen beraten. Wachstumstreiber Die Anstieg der generativen KI -Adoption war dramatischer als selbst die optimistischsten Projektionen, die vorhersagen konnten. Dann a

Agi und KI -Superintelligenz werden die Annahmesperre der menschlichen Decke stark treffen

Jul 04, 2025 am 11:10 AM

Agi und KI -Superintelligenz werden die Annahmesperre der menschlichen Decke stark treffen

Jul 04, 2025 am 11:10 AM

Reden wir darüber. Diese Analyse eines innovativen KI -Durchbruchs ist Teil meiner laufenden Forbes -S?ulenberichterstattung über die neueste in der KI, einschlie?lich der Identifizierung und Erkl?rung verschiedener wirksamer KI -Komplexit?ten (siehe Link hier). Auf dem Weg zu Agi und

Erstellen Sie Ihre erste LLM -Anwendung: Ein Anf?nger -Tutorial

Jun 24, 2025 am 10:13 AM

Erstellen Sie Ihre erste LLM -Anwendung: Ein Anf?nger -Tutorial

Jun 24, 2025 am 10:13 AM

Haben Sie jemals versucht, Ihr eigenes gro?es Sprachmodell (LLM) zu erstellen? Haben Sie sich jemals gefragt, wie Menschen ihre eigene LLM -Anwendung stellen, um ihre Produktivit?t zu steigern? LLM -Anwendungen haben sich in jedem Aspekt als nützlich erwiesen

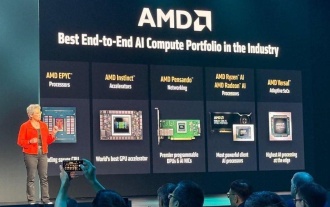

AMD baut immer wieder an Dynamik in KI auf

Jun 28, 2025 am 11:15 AM

AMD baut immer wieder an Dynamik in KI auf

Jun 28, 2025 am 11:15 AM

Insgesamt denke ich, dass die Veranstaltung wichtig war, um zu zeigen, wie AMD den Ball für Kunden und Entwickler auf dem Feld bewegt. Unter SU, M.O. ist klare, ehrgeizige Pl?ne zu haben und gegen sie auszuführen. Ihr Verh?ltnis von ?Say/Do“ ist hoch. Das Unternehmen tut es

Kimi K2: Das m?chtigste Open-Source-Agentenmodell

Jul 12, 2025 am 09:16 AM

Kimi K2: Das m?chtigste Open-Source-Agentenmodell

Jul 12, 2025 am 09:16 AM

Erinnern Sie sich an die Flut chinesischer Open-Source-Modelle, die die Genai-Industrie Anfang dieses Jahres gest?rt haben? W?hrend Deepseek die meisten Schlagzeilen machte, war Kimi K1.5 einer der herausragenden Namen in der Liste. Und das Modell war ziemlich cool.

Zukünftige Vorhersage einer massiven Intelligenz -Explosion auf dem Weg von AI zu AGI

Jul 02, 2025 am 11:19 AM

Zukünftige Vorhersage einer massiven Intelligenz -Explosion auf dem Weg von AI zu AGI

Jul 02, 2025 am 11:19 AM

Reden wir darüber. Diese Analyse eines innovativen KI -Durchbruchs ist Teil meiner laufenden Forbes -S?ulenberichterstattung über die neueste in der KI, einschlie?lich der Identifizierung und Erkl?rung verschiedener wirksamer KI -Komplexit?ten (siehe Link hier). Für diejenigen Leser, die h

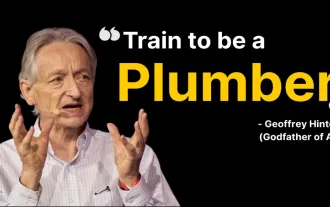

7 wichtige Highlights von Geoffrey Hinton über Superintelligent AI - Analytics Vidhya

Jun 21, 2025 am 10:54 AM

7 wichtige Highlights von Geoffrey Hinton über Superintelligent AI - Analytics Vidhya

Jun 21, 2025 am 10:54 AM

Wenn der Pate von Ai Ihnen sagt, Sie sollen "trainieren, um ein Klempner zu sein", wissen Sie, dass es sich lohnt, auf das H?ren zu gehen - zumindest ist es das, was meine Aufmerksamkeit auf sich gezogen hat. In einer kürzlichen Diskussion sprach Geoffrey Hinton über die potenzielle Zukunft, die von Superintelligent AI gepr?gt ist, und wenn yo